Hombre paralizado logra mover un brazo robótico con las señales de su cerebro

Se utilizó una interfaz basada en un modelo de inteligencia artificial que puede adaptarse a los cambios que se producen en el cerebro cuando una persona repite o imagina un movimiento.

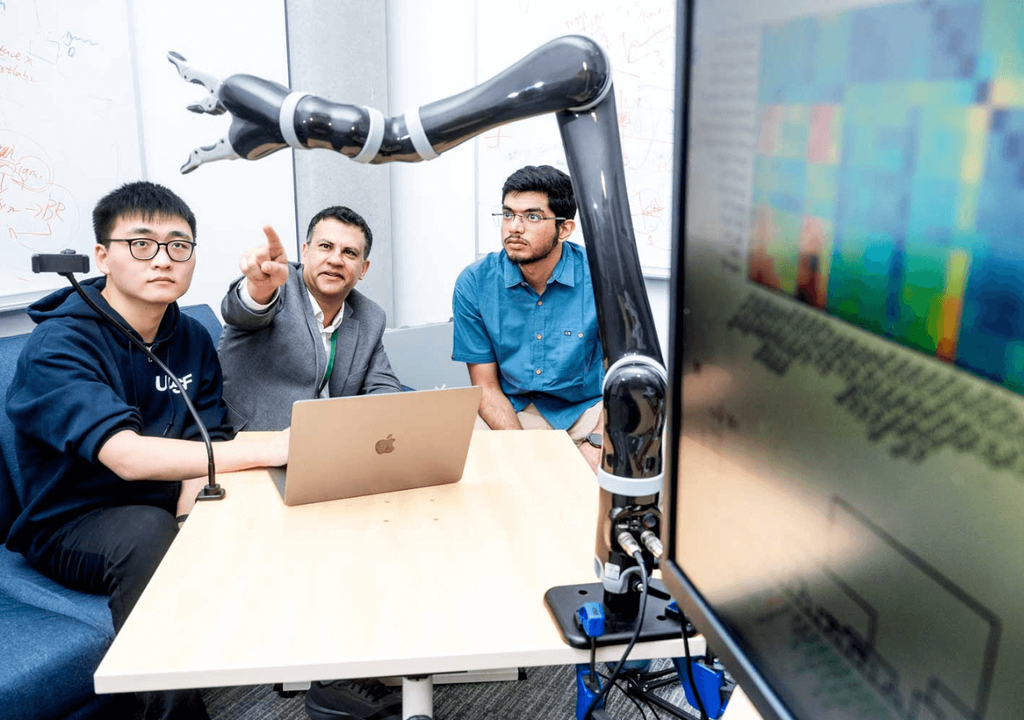

La Universidad de California en San Francisco (UCSF) anunció que un grupo de sus investigadores logró que un hombre paralizado controle un brazo robótico que recibe señales de su cerebro a través de una computadora.

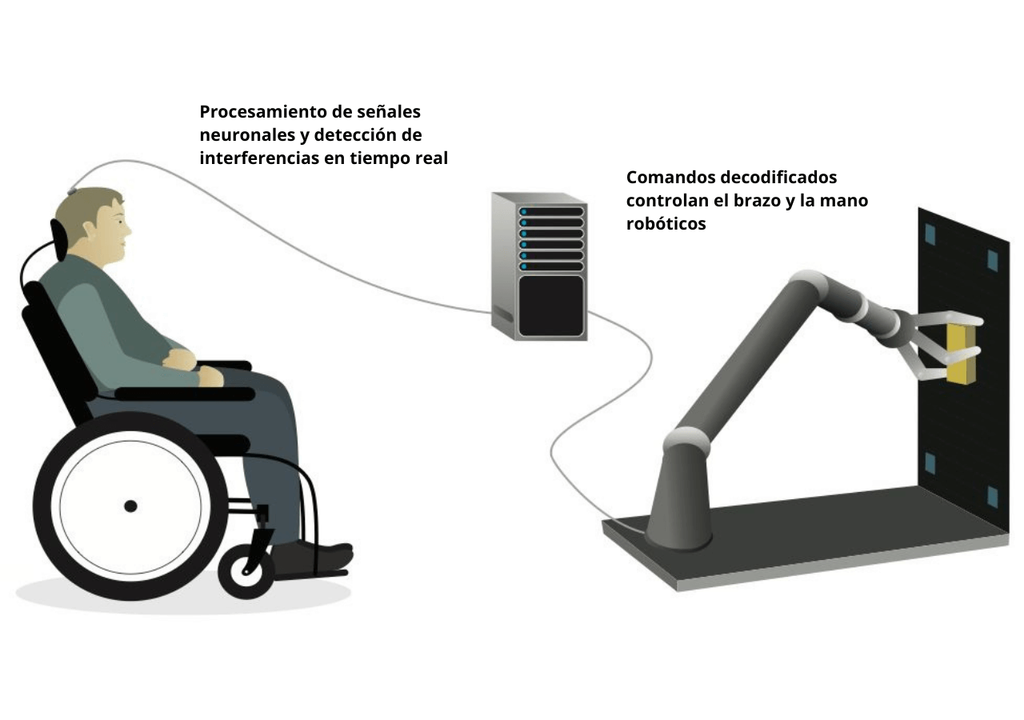

El equipo utilizó un dispositivo, conocido como interfaz cerebro-ordenador (BCI), basado en un modelo de inteligencia artificial (IA) que puede ajustarse a los pequeños cambios que se producen en el cerebro cuando una persona repite o imagina un movimiento y aprende a hacerlo de una manera más refinada.

Move a robotic arm just by imagining? UCSF scientists created a brain-computer interface that lets a person with paralysis control the arm's movement for seven months straight, a first in the field. https://t.co/AWscYwzDUR pic.twitter.com/0LCfQ9NShm

— UC San Francisco (@UCSF) March 6, 2025

Hasta ahora se había logrado que este tipo de dispositivo funcionara por uno o dos días, pero en este experimento lo hicieron por un récord de siete meses sin necesidad de ajustes.

Con el BCI, el participante del estudio, un hombre que había quedado paralizado por un derrame cerebral años antes y que no podía hablar ni moverse, fue capaz de tomar, mover y dejar caer objetos imaginándose a sí mismo realizando esas acciones.

Cómo funciona el dispositivo

La clave fue el descubrimiento de cómo cambia la actividad cerebral a diario cuando el participante del estudio imaginaba repetidamente que hacía movimientos específicos.

Para hacerlo se utilizaron pequeños sensores implantados en la superficie del cerebro del participante, con lo que pudieron captar su actividad cerebral cuando imaginaba mover distintas partes del cuerpo.

Aunque no podía moverse, el cerebro del participante podía producir señales para un movimiento cuando se imaginaba que lo hacía. La BCI registró las representaciones de estos movimientos en el cerebro a través de sensores, con lo que equipo de investigación descubrió que la forma de las representaciones en el cerebro permanecía igual, pero su ubicación cambiaba ligeramente de un día para otro.

Se le pidió al participante que se imaginara haciendo movimientos simples con sus dedos, manos o pulgares durante el transcurso de dos semanas, mientras su actividad cerebral era registrada para entrenar una IA.

Al principio, el participante intentó controlar un brazo y una mano robóticos, pero sus movimientos no eran precisos. Tras ello, se le pidió que practicara con un brazo robótico virtual que le daba retroalimentación sobre la precisión de sus visualizaciones.

Cuando logró que el brazo virtual hiciera lo que él quería, comenzó a practicar con un brazo robótico real. Tras pocas sesiones de práctica logró que el brazo robótico recogiera bloques, los girara y los moviera a nuevas ubicaciones. Incluso podía abrir un armario, sacar una taza y acercarla a un dispensador de agua.

Mejoras para hacerlo más rápido y suave

De acuerdo a la investigación, publicada en la revista Cell, meses después el participante todavía podía controlar el brazo robótico, tras unos 15 minutos para ajustar la forma en que sus representaciones de movimiento habían cambiado desde que comenzó a usar el dispositivo.

“Esta combinación de aprendizaje entre humanos e IA es la siguiente fase de estas interfaces cerebro-computadora”, sostuvo en un comunicado de la universidad. “Es lo que necesitamos para lograr una función sofisticada y similar a la de la vida real”, aseguró.

Referencias de la noticia:

-Artículo en Cell. Sampling representational plasticity of simple imagined movements across days enables long-term neuroprosthetic control.

-Comunicado de prensa U. de California en San Francisco. How a paralyzed man moved a robotic arm with his thoughts.